2025年AI算力市场:推理芯片挑战者崛起,英伟达还能稳坐钓鱼台吗?

2025年,AI算力市场将迎来一场深刻的变革。行业焦点从“训练模型”转向“模型推理”,推理基础设施需求激增。大模型的商业化落地依赖于AI推理,千行百业的应用将重塑AI工作负载格局。大规模训练是“研发阶段”,推理则是“商业化阶段”,谁能主导推理市场,谁就能在AI领域获得更大的收益。

巴克莱研报预测,AI推理计算需求将占总需求的70%以上,甚至可能超过训练需求的4.5倍。这为专注于推理的“小”芯片公司提供了绝佳的发展机遇。Groq、SambaNova、Positron AI等初创公司正向英伟达发起挑战。

训练芯片与推理芯片:有何不同?

我们将AI训练比作“考驾照”,推理则是“上路”。训练需要“教练”(优化算法)指导模型;推理则需要模型基于已学知识灵活应对实际情况。因此,推理阶段比训练更高效,仅涉及前向传播。

训练芯片拥有更高的计算能力,用于处理训练过程中的海量计算和数据;推理芯片则需要较少的计算能力即可完成任务。传统CPU和GPU虽然也能进行推理,但效率和成本方面各有不足。CPU速度慢,GPU成本高且功耗大,延迟也较高。

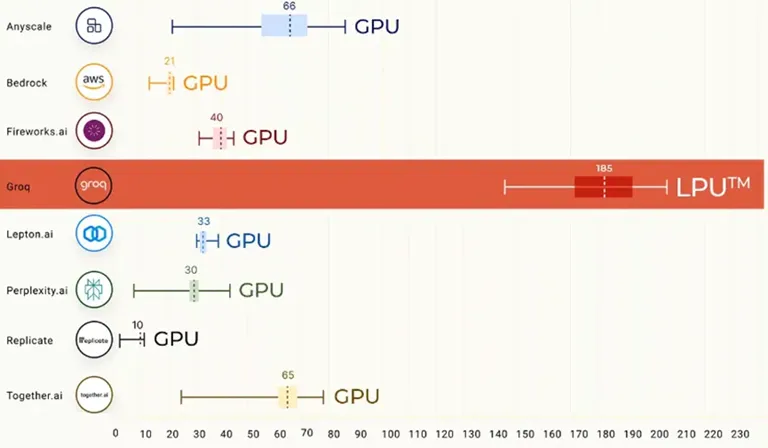

因此,“小”芯片公司的核心竞争力在于优化推理的时间成本和资金成本,例如Groq通过其LPU(线性处理单元)技术,号称实现了“世界最快推理”,速度远超GPU,成本也更低。

挑战者们的策略:

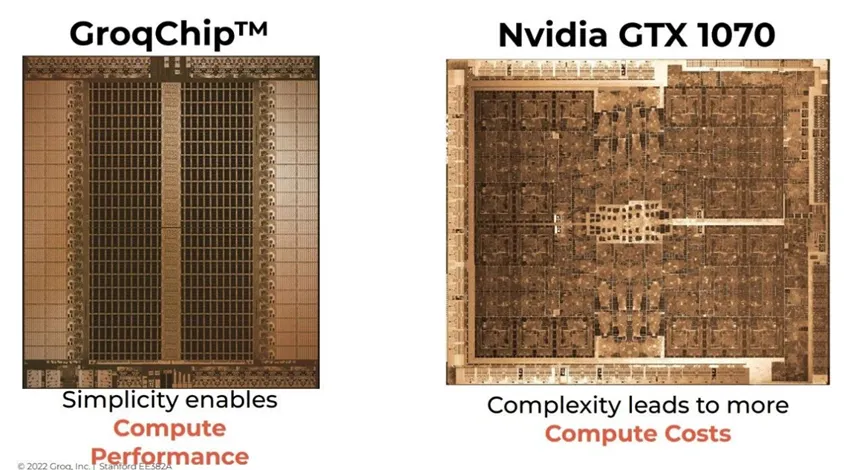

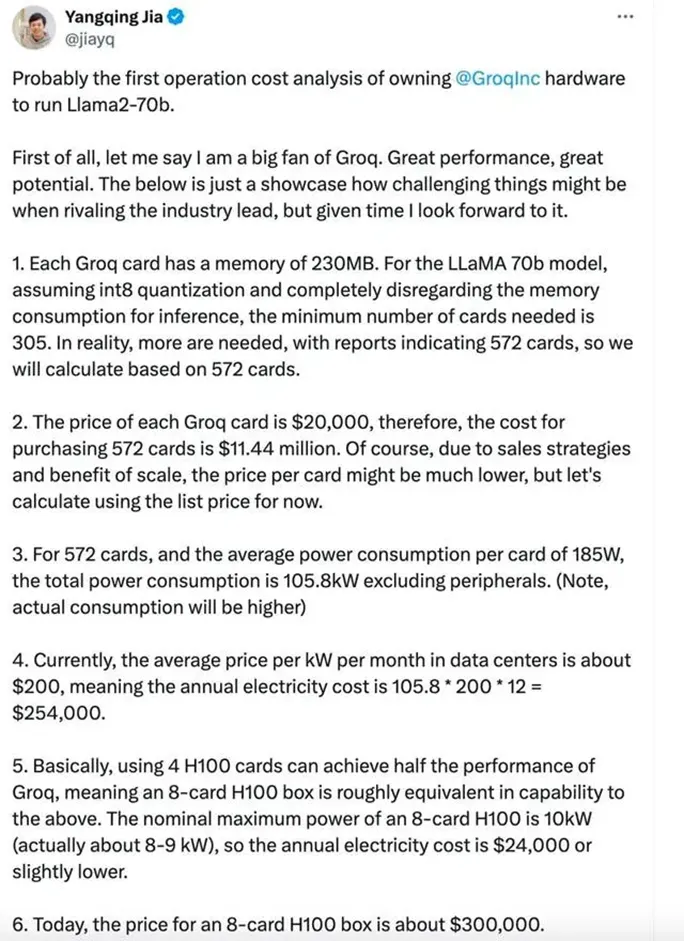

- Groq: 由前谷歌TPU团队成员创立,其LPU技术通过将大量计算资源集中在片内共享内存,避免外部内存频繁调用,从而提升效率。但其高昂的成本和较低的内存容量(230MB)限制了其应用范围。虽然Groq宣称其速度是英伟达GPU的10倍,成本和能耗只有其十分之一,但贾扬清和姚金鑫等专家认为,在实际应用中,Groq的成本和能耗反而更高。

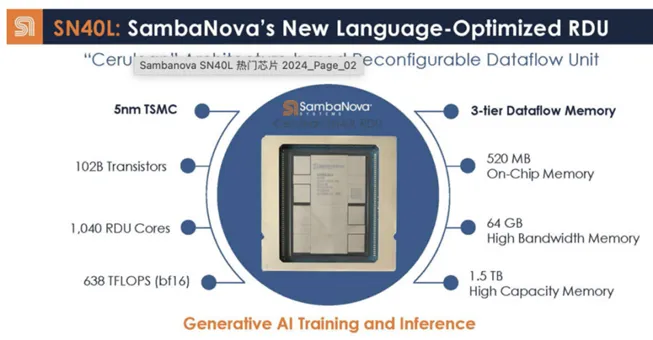

- SambaNova: 估值高达50亿美元,其RDU架构兼具高容量的SRAM和HBM,并实现高达90%的HBM利用率,性能是GPU的2-4倍。SambaNova的业务模式也更具野心,不只销售芯片,还提供完整的技术栈,包括服务器系统和模型部署。其目标是大企业私有数据的AI应用。

- Positron AI: 成立时间较短,但其推理芯片成本仅为英伟达H100的五分之一,且性能相当。其愿景是让人人用得起AI推理。

英伟达的应对:

英伟达推出了B300系列推理芯片,算力提升50%,显存增至288GB,有效提升大模型推理性能。英伟达在其他领域也积极布局,例如为云计算、5G、游戏、汽车等领域定制芯片,并将于2025年上半年发布人形机器人芯片Jetson Thor。

结语:

AI推理芯片市场的竞争日益激烈,英伟达的地位面临挑战,但其多元化布局和强大的技术实力仍使其占据优势。对于挑战者而言,如何在成本、性能和应用场景上找到突破口,将决定其最终能否成功挑战英伟达的霸主地位。与其想着“干掉”英伟达,不如专注于开拓新的市场和技术方向。

还没有评论,来说两句吧...